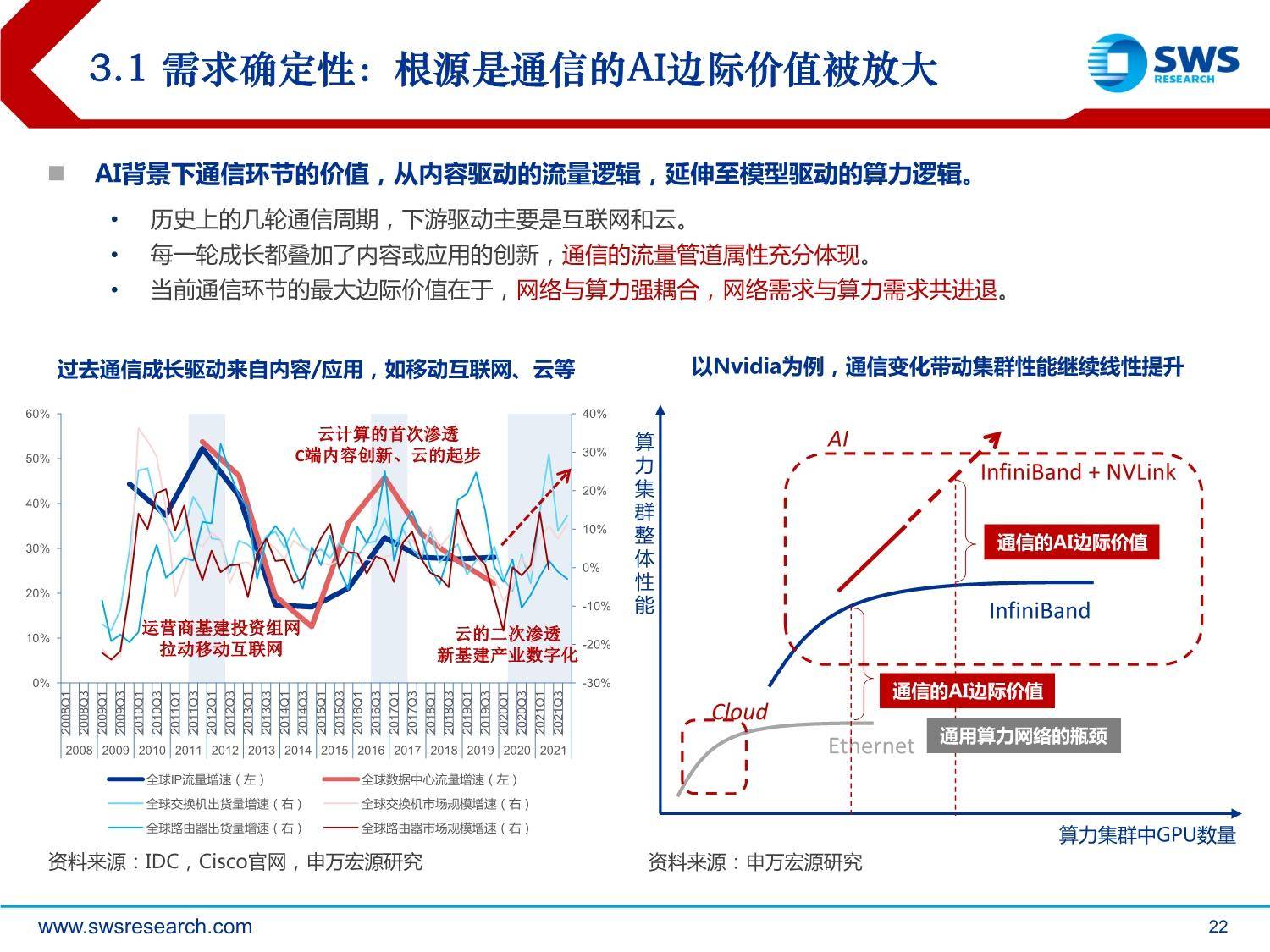

2024年AI算力行业投资策略:全产业创新不断,国产化向阳而生

大模型时代,训练需求飙升

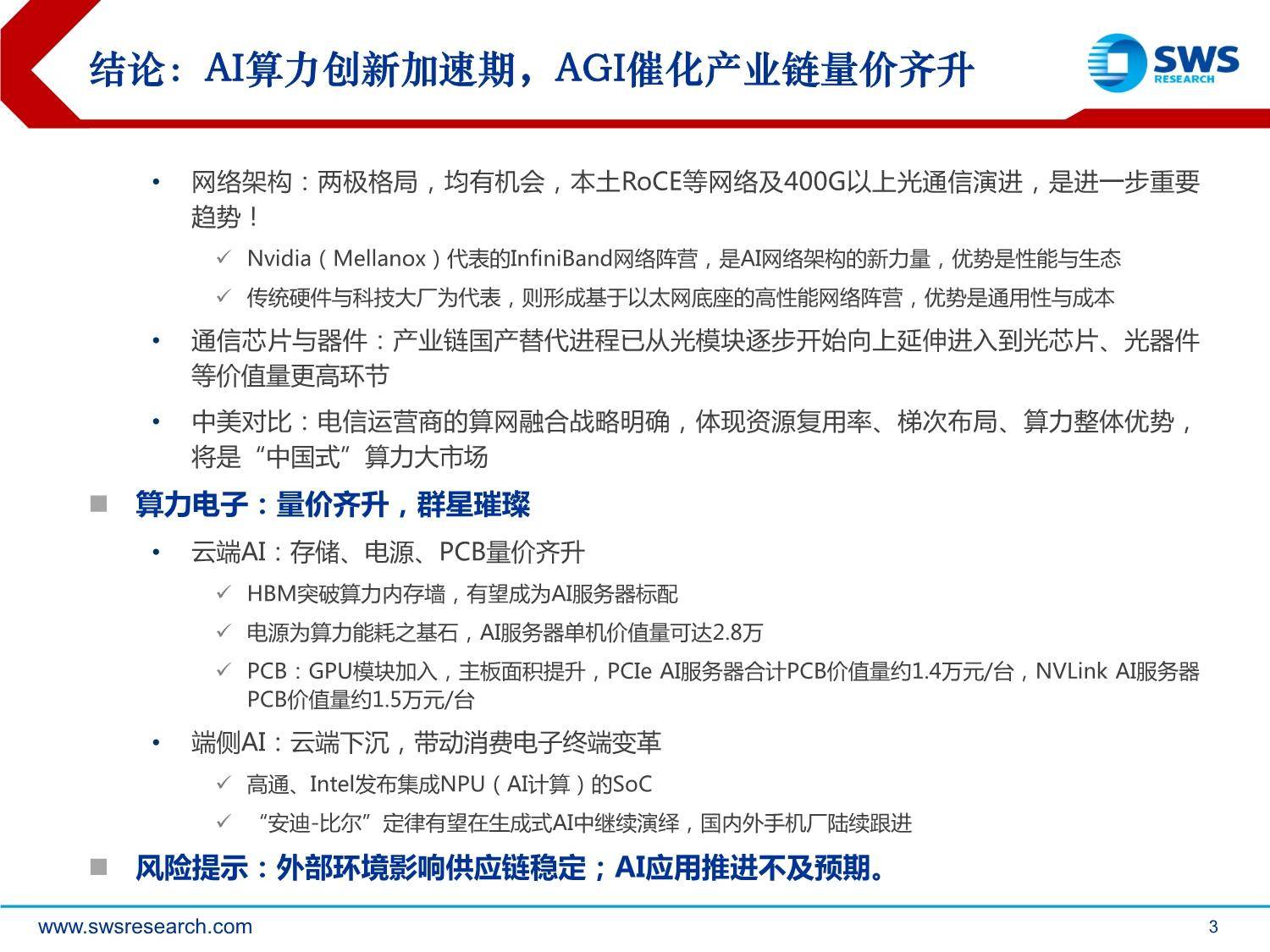

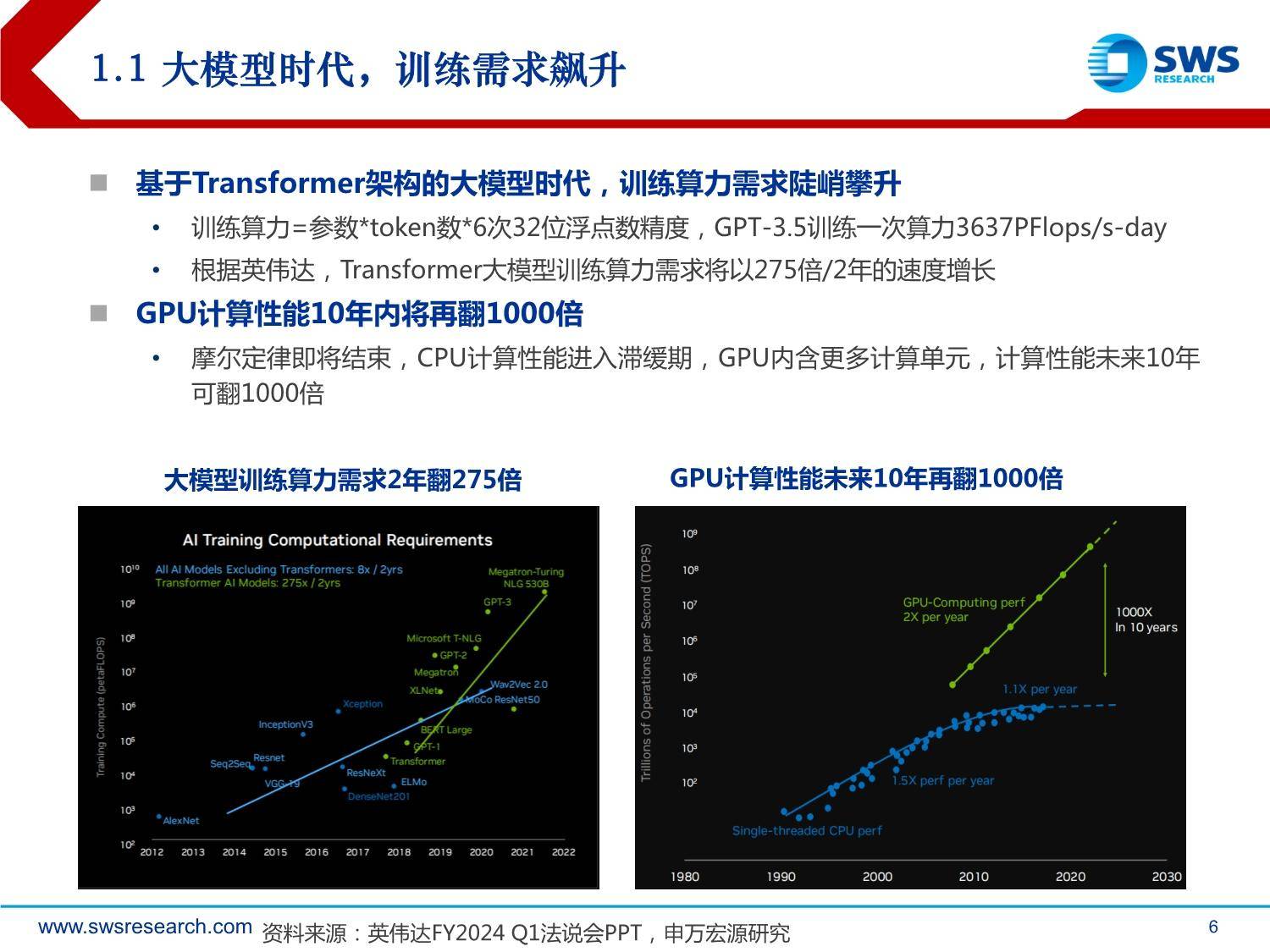

基于Transformer架构的大模型时代,训练算力需求陡峭攀升

训练算力=参数*token数*6次32位浮点数精度,GPT-3.5训练一次算力3637PFlops/s-day

根据英伟达,Transformer大模型训练算力需求将以275倍/2年的速度增长

GPU计算性能10年内将再翻1000倍

摩尔定律即将结束,CPU计算性能进入滞缓期,GPU内含更多计算单元,计算性能未来10年 可翻1000倍

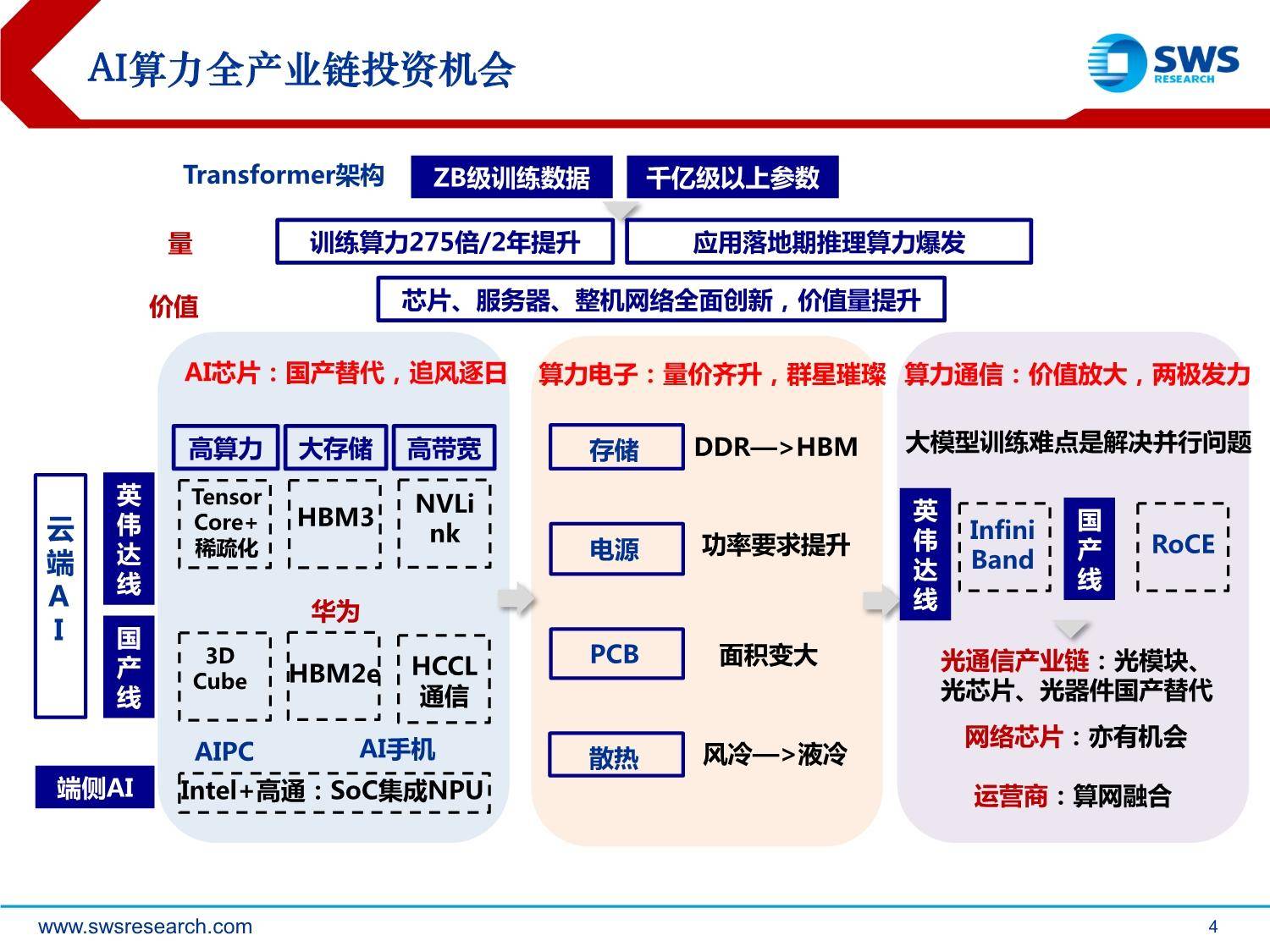

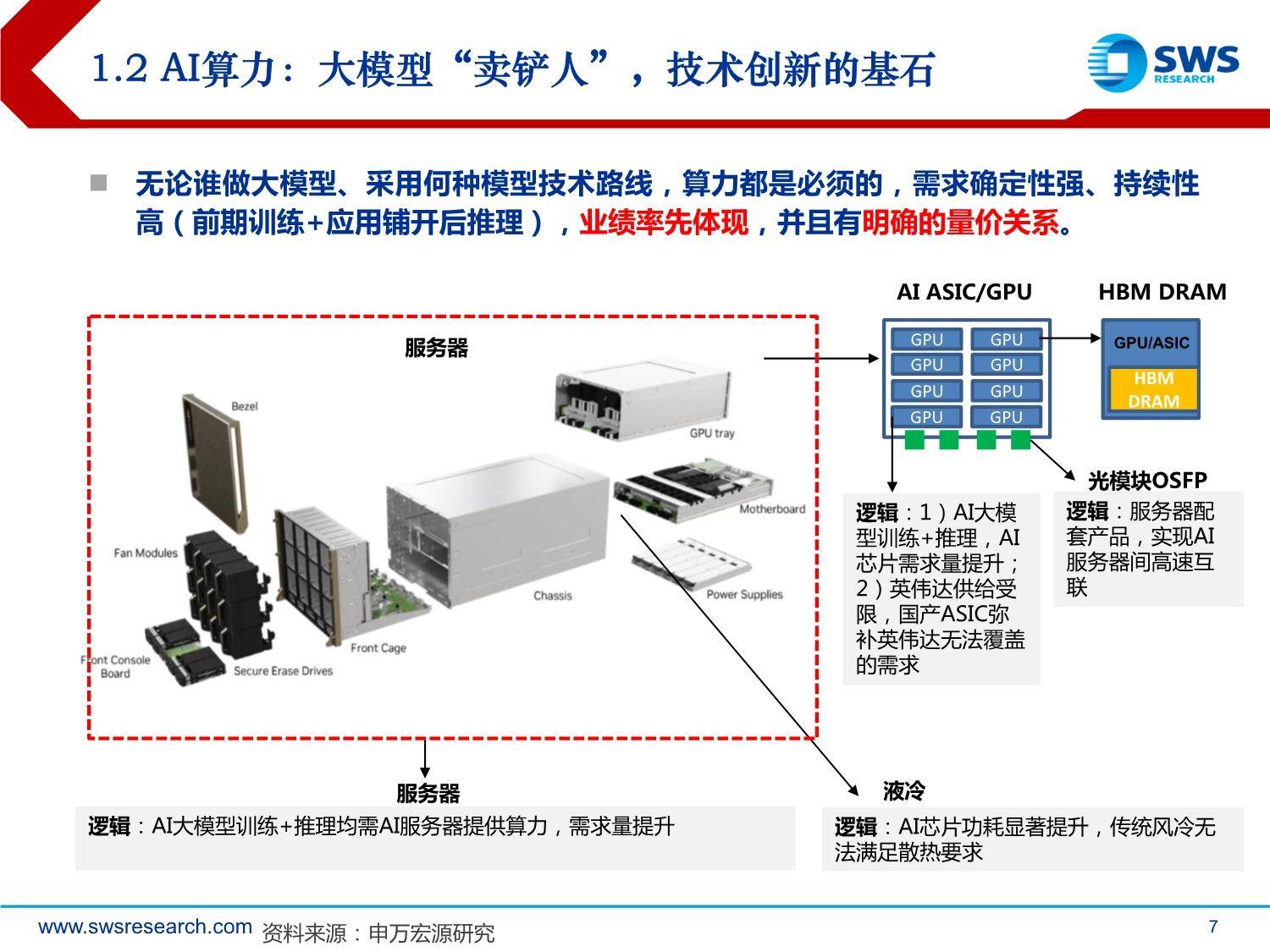

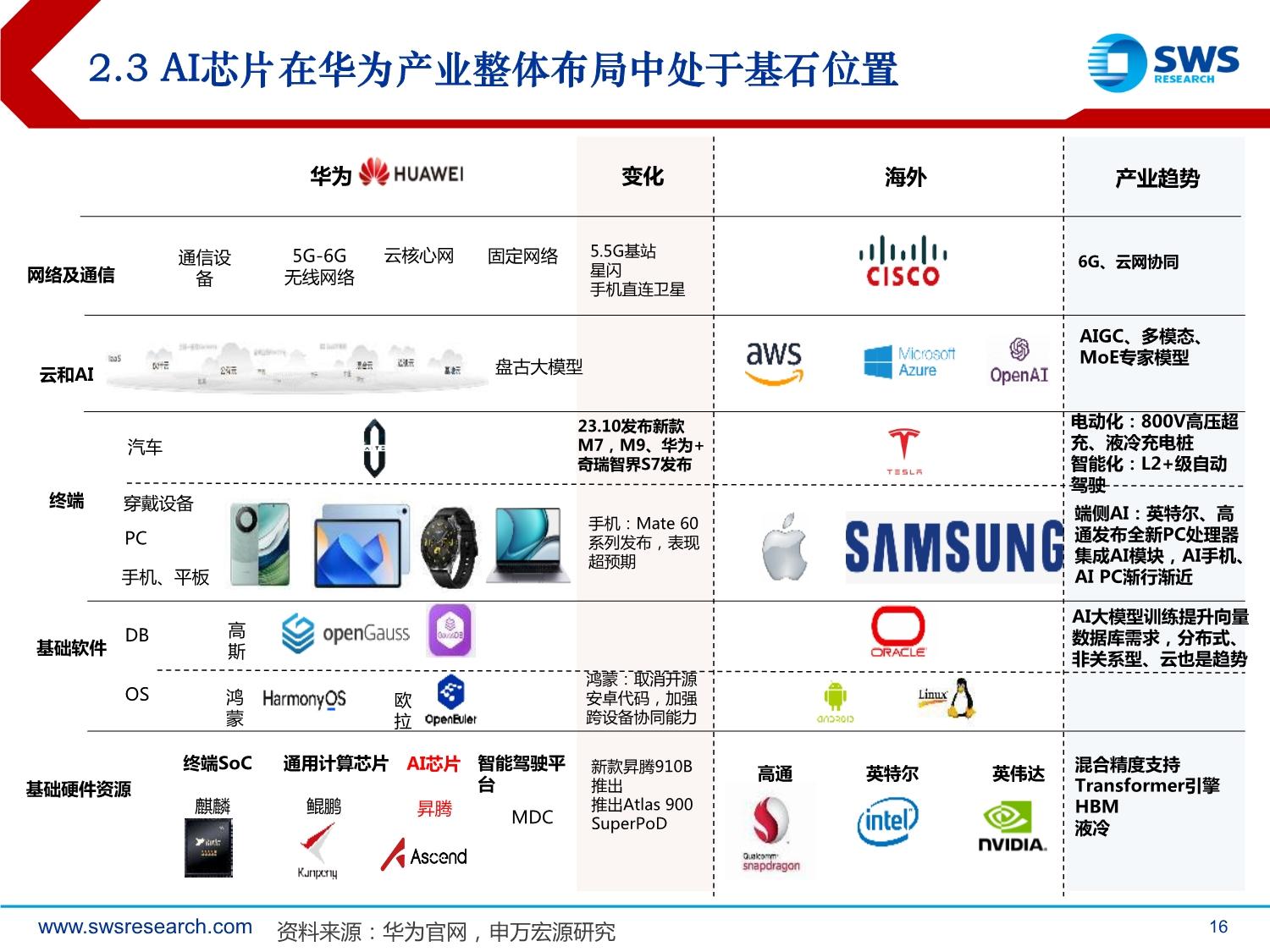

AI算力:大模型“卖铲人”,技术创新的基石。

无论谁做大模型、采用何种模型技术路线,算力都是必须的,需求确定性强、持续性 高(前期训练+应用铺开后推理),业绩率先体现,并且有明确的量价关系。

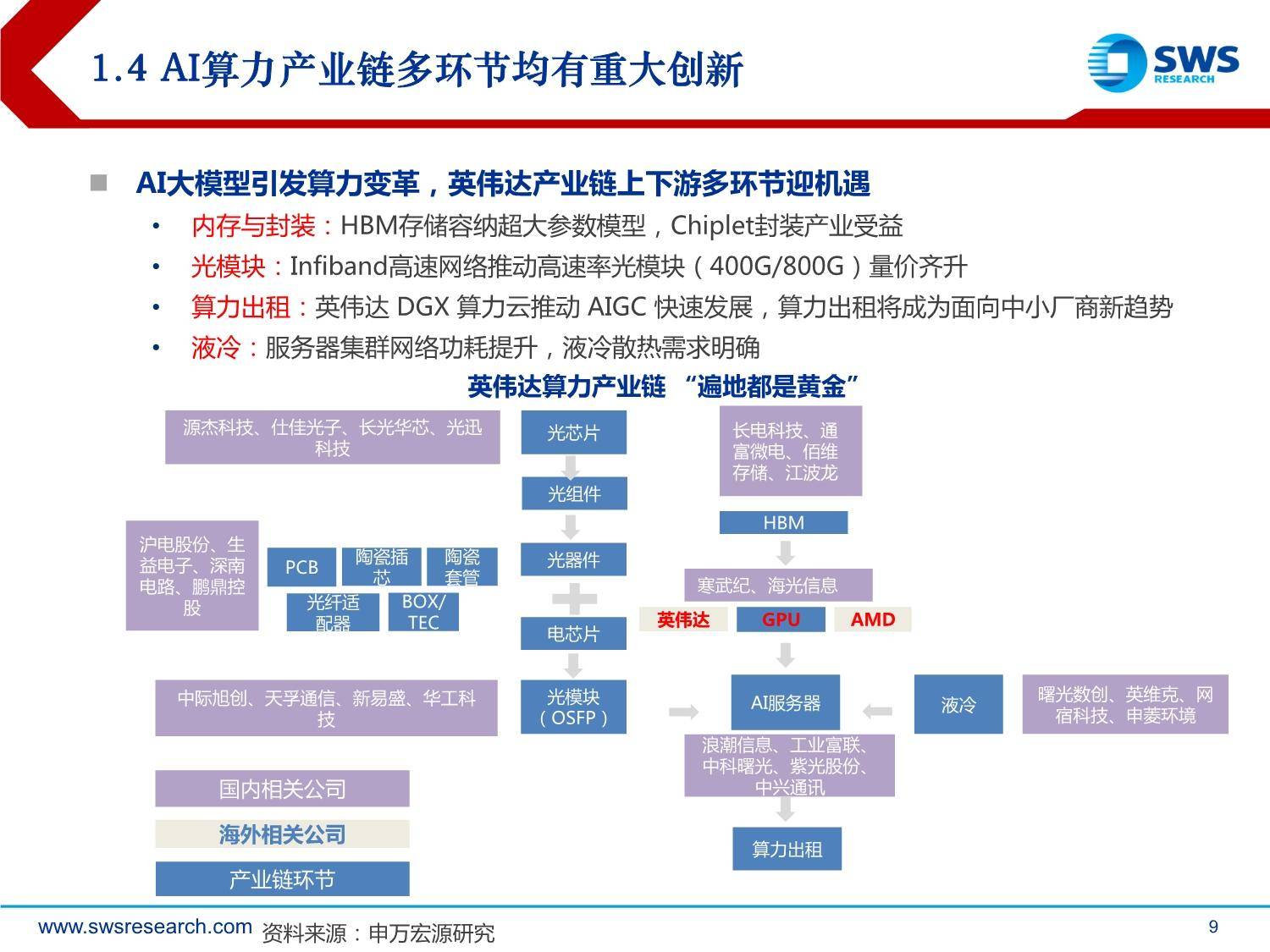

AI算力产业链多环节均有重大创新

AI大模型引发算力变革,英伟达产业链上下游多环节迎机遇

内存与封装:HBM存储容纳超大参数模型,Chiplet封装产业受益

光模块:Infiband高速网络推动高速率光模块(400G/800G)量价齐升

算力出租:英伟达 DGX 算力云推动 AIGC 快速发展,算力出租将成为面向中小厂商新趋势

液冷:服务器集群网络功耗提升,液冷散热需求明确

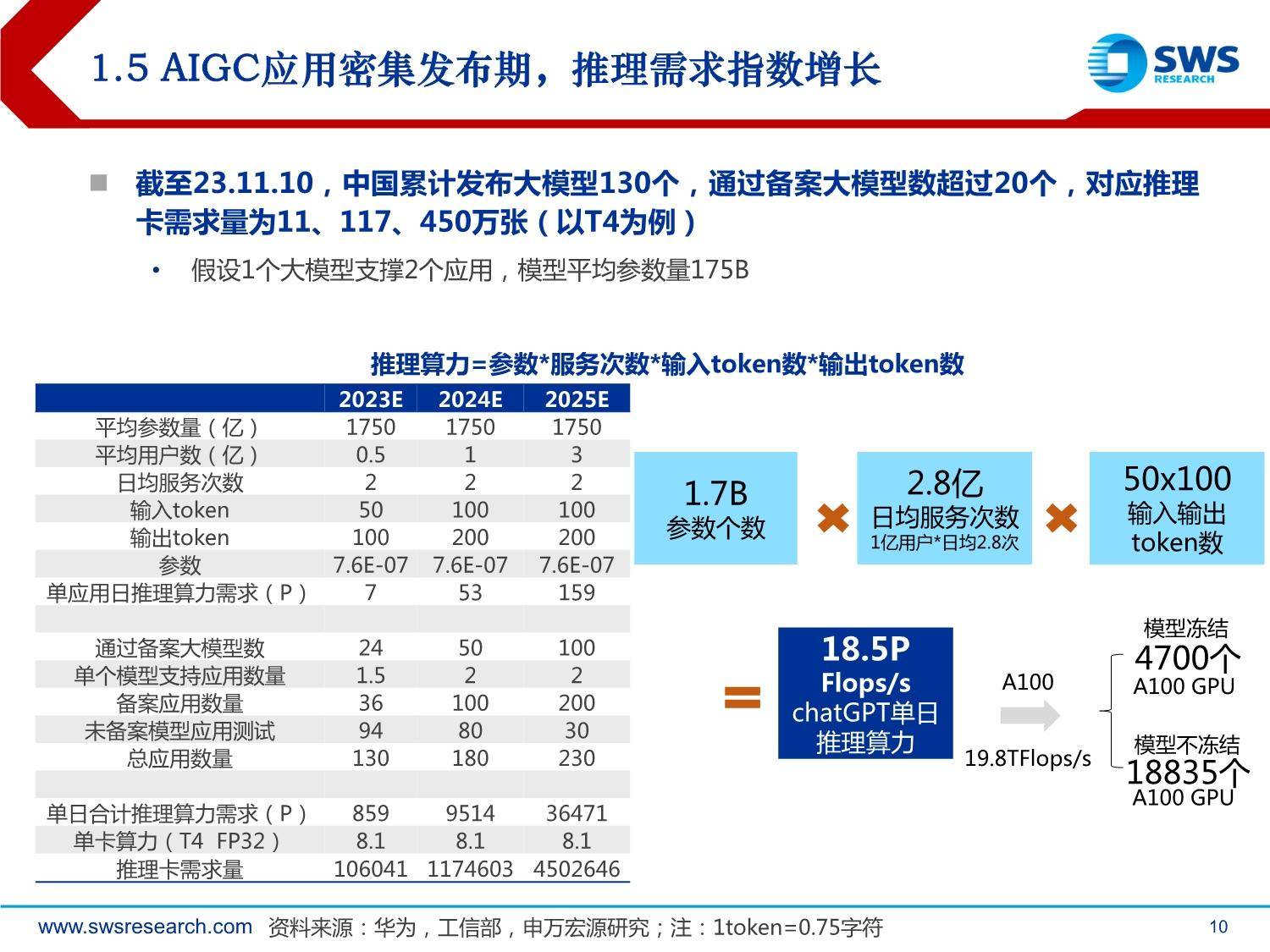

AIGC应用密集发布期,推理需求指数增长

截至23.11.10,中国累计发布大模型130个,通过备案大模型数超过20个,对应推理 卡需求量为11、117、450万张(以T4为例)。 假设1个大模型支撑2个应用,模型平均参数量175B

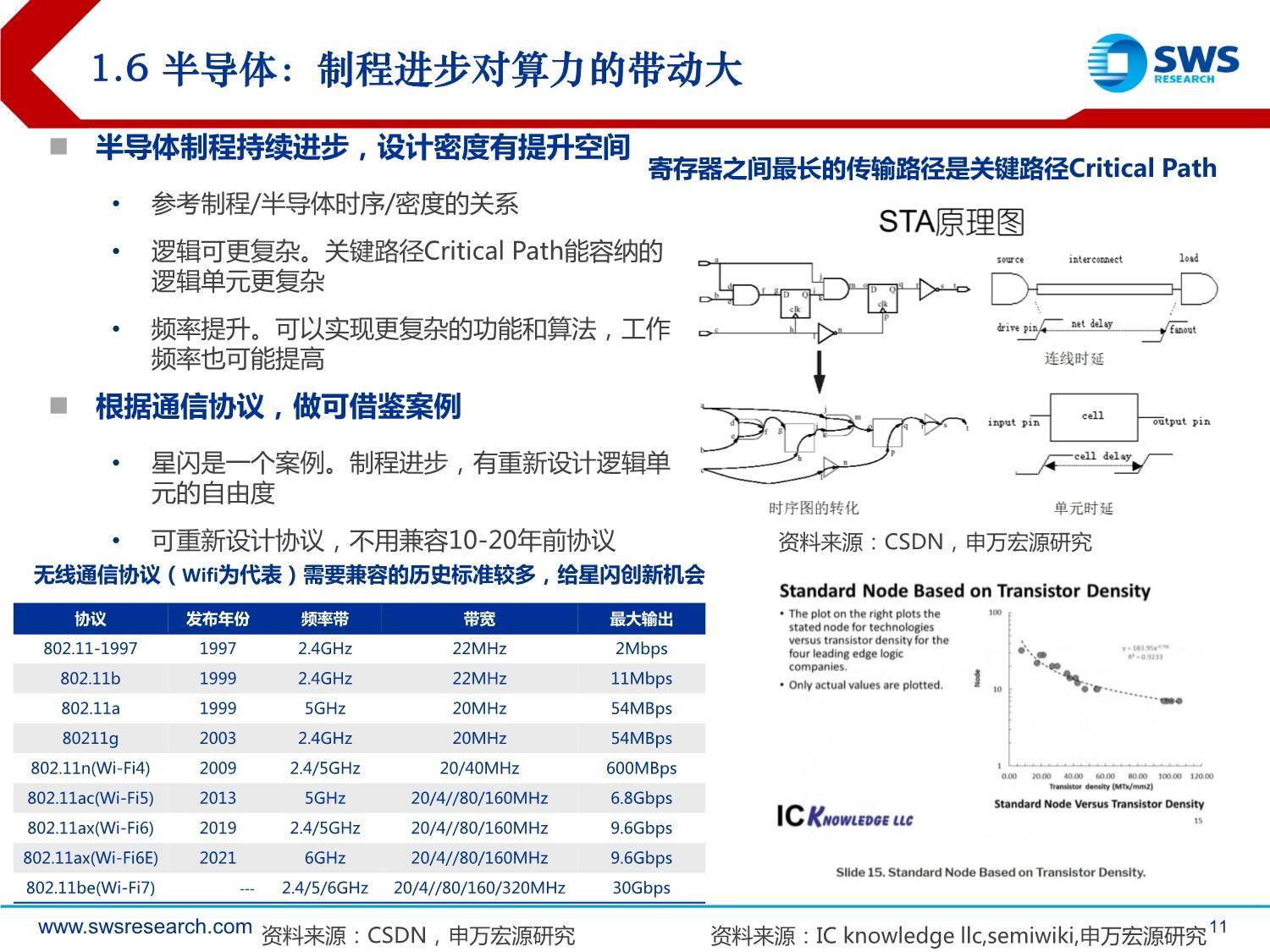

半导体:英伟达GPU为例,制程进步带动大

两轮2010年以来英伟达GPU主要架构可以推测行业趋势:注重互联,对AI支持与时俱 进(从Cuda Core到Tensor Core,增加对INT/BF16等AI新趋势的支持,结构稀疏矩 阵支持),注重带宽和扩展性而非核心数量等

.......

来源:申万宏源

报告内容节选如下: